Pēc gadiem ilgas slēgtas AI, Openai vairāk nekā piecu gadu laikā klusi ieviesa savus pirmos atklāti pieejamos valodas modeļus: GPT -OSS – 120B un GPT -OSS -20BApvidū Šie modeļi klasiskajā nozīmē nav pilnībā atvērtā avotābet viņi ļauj ikvienam lejupielādēt apmācītus modeļa svarus un palaiž tos lokāli, precīzi tos vai pārpludināt tos, kamēr jūs ievērojat Apache 2.0 licenci.

Openai izpilddirektors Sems Altmans dalījās ar ziņām ziņojumā par X: “GPT-OSS ir ārā! Mēs izveidojām atvērtu modeli, kas darbojas O4-Mini līmenī un darbojas ar augstas klases klēpjdatoru (WTF !!) (un mazāks, kas darbojas pa tālruni). Ļoti lepojas ar komandu; liels tehnoloģiju triumfs.”

Galvenie akcenti

-

Pieejami divi modeļi: GPT -OSS – 120B un GPT -OSS – 20B.

-

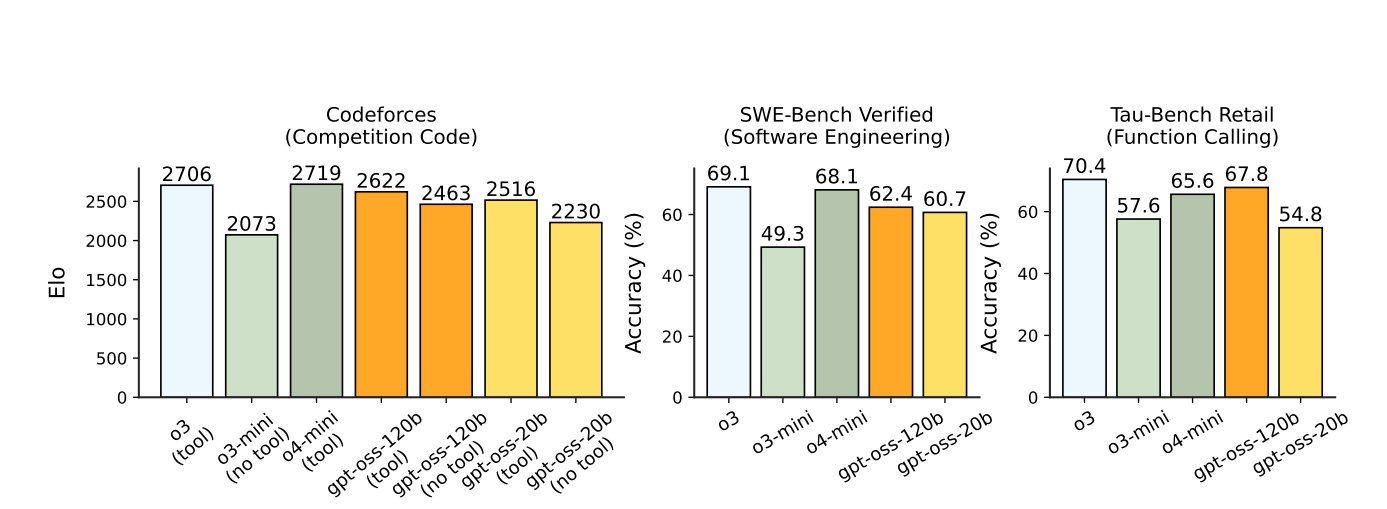

Sniegums: 120B modeļa konkurentu Openai patentētais O4 -Mini, savukārt mazāks modelis darbojas līdzīgi kā O3 -mini.

-

Aparatūras prasības: 120B modelis var darboties ar vienu augstas pakāpes NVIDIA GPU. 20B modelis ir pietiekami viegls, lai darbotos daudzos patērētāju klēpjdatoros ar 16 GB RAM vai pat viedtālruņiem.

-

Licencēšana un piekļuve: Abi tiek atbrīvoti saskaņā ar Apache 2.0 licenci, ļaujot komerciālai lietošanai un pārdalei. Tos var lejupielādēt no galvenajiem AI modeļa centriem un mākoņu platformām.

-

Mākoņu integrācija: Pieejams uz AWS pamatiežiem, Sagemaker, Azure un Databricks. AWS ziņo, ka 120B modelis piedāvā izmaksu un veiktspējas priekšrocības salīdzinājumā ar konkurējošajiem modeļiem no Google, DeepSeek un citiem.

-

Drošības pasākumi: Openai divreiz aizkavēja izlaidumu, lai pirms palaišanas veiktu plašus drošības testus un ārējās revīzijas.

Šis ir Openai pirmais atklātā svara izlaidums vairāk nekā piecu gadu laikā, kas norāda uz stratēģisku maiņu, kā uzņēmums dalās ar savu tehnoloģiju. Padarot pieejamus svarus, Openai ļauj izstrādātājiem, pētniekiem un pat hobijiem vadīt progresīvus valodu modeļus lokāli vai mākonī, nepaļaujoties uz patentētām API.

Pārcelšanās liek Openai tiešākā konkurencē ar citiem atklātā svara līderiem, piemēram, Meta’s Llama, DeepSeek -R1, Alibaba Qwen un Mistral. Tas attiecas uz pieaugošo pieprasījumu pēc AI modeļiem, kas piedāvā caurspīdīgumu, pielāgojamību un neatkarību no slēgtām platformām.

Mazākām komandām un jaunizveidotiem uzņēmumiem spēja precīzi noteikt vai pārkārtot šos modeļus ar pieļaujamo licenci nozīmē, ka tie var izveidot augsta līmeņa AI lietojumprogrammas bez apmācības infrastruktūras izmaksām no nulles.

Palaišana iezīmē pagriezienu no Openai nesenās slēgtās stratēģijas, kur vairums modeļu, kas paslēpti aiz Chatgpt, nekad nepadara savus iekšējos svarus publiskus. Izmantojot GPT -OSS, jums tagad ir divas valodu sistēmas, kas atbalsta pakāpenisku spriešanu, rīku izmantošanu, piemēram, koda izpildei vai pārlūkošanu, un pārslēdzama spriešanas piepūles režīmu (zemu, vidēju vai augstu), kas precizitātes dēļ tirgo latentumu.

Openai GPT -OSS – 120B

Lielāks modelis, GPT -OSS -122B, pulksteņi ir aptuveni 117–120 miljardu parametru, bet, pateicoties arhitektūrai ar maisījumu, un efektīvai kvantēšanai, tikai aptuveni 5 miljardi parametru ir aktīvi uz marķiera. Mazākam, GPT -OSS -20B ir nepieciešami nedaudz vairāk kā 16 GB RAM – pietiekami, lai palaistu daudzos mūsdienu klēpjdatoros vai pat jaudīgos viedtālruņos.

Openai pirms palaišanas smagi pārbaudīja abus. Tā vietā, lai tikai pieņemtu drošu lietošanu, viņi rīkoja pretrunīgas simulācijas – turpiniet, kā slikts aktieris varētu precīzi noteikt svaru, lai radītu kaitīgu saturu. Šos testus pārskatīja ārējie eksperti, un modeļi nesasniedza problemātisku spēju līmeni tādās jomās kā bioapstrādes vai kiberdrošība. Openai divreiz aizkavēja izlaidumu, lai šie novērtējumi būtu pareizi.

Etalīnos GPT -OSS – 120B bieži konkurē ar Openai slēgto patentēto O4 -Mini modeli un pārspēj O3 -Mini. 20B modelis nolaižas netālu no O3-Mini teritorijas. Viņi arī labi izturas pret instrumentu izmantošanu un spriešanas spraugām, lai gan dažos faktiskos uzdevumos tie uzrāda nedaudz vairāk halucinācijas nekā augstākās klases slēgtās sistēmas.

Šis izlaidums pozicionē Openai tiešāk pret citiem atklātā svara smagajiem svariem: Meta’s Llama 4, ķīniešu milžiem, piemēram, DeepSeek -R1 un Alibaba Qwen, kā arī Eiropas mistral modeļi. Visi tie izmanto līdzīgu pieļaujamu licencēšanu, piemēram, Apache 2.0. Openai skaidri pateica, ka šī pieeja samazina barjeru izstrādātājiem un pētniekiem visā pasaulē – it īpaši pieaugošās bažas par atkarību no patentētām AI kaudzēm.

No praktiskā viedokļa izstrādātāji var iegūt modeļus no sejas apskaušanas vai palaist tos mākonī, izmantojot AWS pamatiežus, Sagemaker, Azure vai Databricks. AWS pat uzsvēra, ka GPT -OSS -120B nodrošina līdz trīs reizes lielāku Google Gemini izmaksu efektivitāti un tiešraides salīdzinājumos pārspēj DeepSeek -R1 un O4 -mini.

Kaut arī apmācības kods un datu kopa joprojām ir privāta, fakts, ka Openai izlaida apmācītus svarus zem Apache 2.0, padara šos modeļus neparasti atvērtus uzņēmumam. Viņi nav pilnībā atvērti, bet izstrādātājiem rada daudz lielāku redzamību un kontroli nekā iepriekšējie izlaidumi.

Salīdzināšanas tabula

| Modeļa variants | Lielums (parametri) | Salīdzināms slēgts modelis | Skrien lokāli? | Ideāls lietošanas gadījums |

|---|---|---|---|---|

| GPT -OSS – 120B | ~ 120 miljardi | O4 -Mini | Jā, augstas klases GPU | Augstas veiktspējas argumentācija un instrumentu izmantošana |

| GPT -OSS -20B | ~ 20 miljardi | O3 -Mini | Jā, klēpjdatoros/tālruņos | Viegli AI uzdevumi, mobilā izvietošana |

🚀 Vai vēlaties, lai jūsu stāsts būtu redzams?

Iegūstiet tūkstošiem dibinātāju, investoru, PE firmas, tehnoloģiju vadītāju, lēmumu pieņēmēju un tehnoloģiju lasītāju priekšā, iesniedzot savu stāstu Techstarts.comApvidū

Piedāvājiet