Gadiem ilgi kiberdrošības komandas uztraucās par pikšķerēšanas e-pastiem, izspiedējvīrusu grupām un mākoņdatošanas pārkāpumiem. Tagad uzmanības centrā ir jauna problēma: autonomi AI aģenti, kas var lasīt e-pastu, rakstīt kodu, izpildīt komandas, pārvietot naudu un mijiedarboties ar citām sistēmām bez cilvēka piekrišanas katrā solī.

Šī maiņa rada jaunu uzbrukuma virsmu visā internetā, un jaunizveidotie uzņēmumi sacenšas, lai ap to izveidotu drošības infrastruktūru.

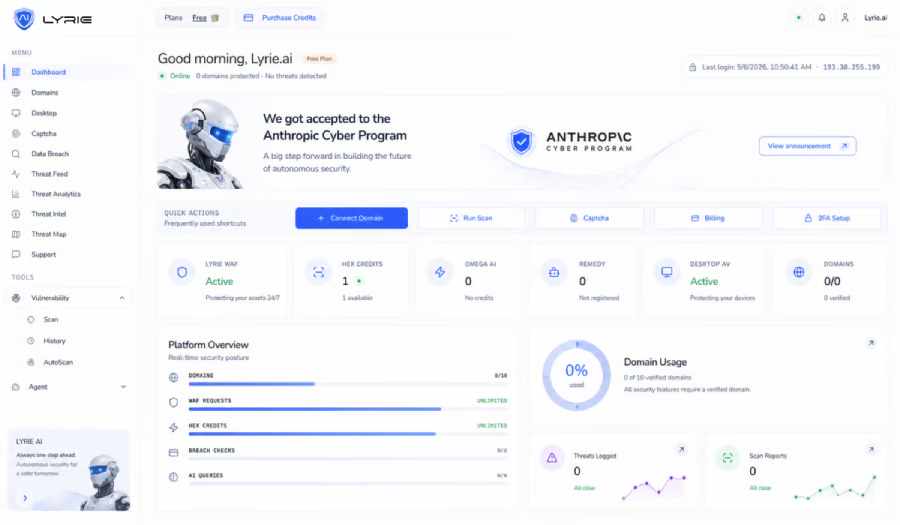

Lyrie.aidrošības platforma, ko izstrādājusi OTT Cybersecurity LLC, otrdien paziņoja, ka tā ir izvietojusi reāllaika nulles dienas izsekošanas un atklāšanas sistēmu, kas izveidota, lai identificētu ievainojamības, pirms publiskas ļaunprātīgas izmantošanas spirālē nonāk liela mēroga pārkāpumos. Uzņēmums arī paziņoja par uzņemšanu AntropisksKiberpārbaudes programmu un izlaida jaunu atvērtu kriptogrāfijas sistēmu, ko sauc par Agent Trust Protocol jeb ATP, kuras mērķis ir nodrošināt autonomus AI aģentus, kas darbojas tiešsaistē.

Kāpēc AI aģenti rada jaunu drošības aklo zonu

Paziņojums nāk, kad uzņēmumi iespiež AI aģentus dziļāk uzņēmuma darbplūsmās. Lieli valodu modeļi vairs neaprobežojas tikai ar atbildēm uz uzvednēm tērzēšanas logos. Viņi sāk tieši mijiedarboties ar API, iekšējām sistēmām, programmatūras krātuvēm, finanšu rīkiem un klientu datiem. Šī pāreja ir radījusi arvien lielākas bažas kiberdrošības nozarē: nevienam vēl nav pilnībā jāatrisina problēma, kas saistīta ar pārbaudi, vai AI aģents ir likumīgs, pilnvarots vai apdraudēts.

Lyrie saka, ka tās platforma tika veidota, pamatojoties uz šo problēmu.

Uzņēmuma draudu izlūkošanas dzinējs nepārtraukti uzrauga infrastruktūru, atvērtā koda repozitorijus, API un aģentu saziņas kanālus, lai atklātu jaunas ievainojamības pazīmes. Kad nulles dienas izmantošana ir apstiprināta, platforma ģenerē izpaušanas pakotnes, kas ietver tehnisko analīzi, sanācijas norādījumus un koncepcijas pierādījumu informāciju ietekmētajām organizācijām.

Sacensības, lai apturētu nulles dienas uzbrukumus, pirms tie izplatās

Vairākos pārbaudītos incidentos Lyrie teica, ka skartās organizācijas saņēma sanācijas atbalstu dažu stundu laikā pēc atklāšanas, pirms tika atklāta informācija.

“Atšķirība starp pārkāpumiem un gandrīz garām gadījumiem parasti tiek mērīta stundās. Mēs izveidojām Lyrie, lai tā būtu sistēma, kas atrod draudus, pirms tā atrod jūs, un precīzi norāda, kā ar to rīkoties,” sacīja Gajs Šītrits, OTT Cybersecurity LLC, uzņēmuma Lyrie.ai, izpilddirektors un dibinātājs.

Starta uzņēmums sevi pozicionē mazāk kā tradicionālu kiberdrošības piegādātāju, bet vairāk kā autonomu AI sistēmu pamata uzticības slāni.

Šī pozicionēšana kļuva skaidrāka, izlaižot aģentu uzticības protokolu.

Protokols mēģina atrisināt pieaugošu problēmu starp aģentu AI sistēmām: identitātes pārbaudi. Tā kā AI aģenti sāk mijiedarboties viens ar otru tiešsaistē, organizācijām ir nepieciešams veids, kā pārbaudīt, kurš aģentu izvietojis, kādas atļaujas tam ir, vai tā norādījumi ir mainīti un vai tā piekļuve ir atsaukta.

Saskaņā ar Lyrie teikto, ATP ļauj sistēmām apstiprināt AI aģenta identitāti, darbības jomu, deleģēšanas pilnvaras, atestācijas statusu un atsaukšanas vēsturi reāllaikā.

“Ikviens AI aģents internetā mūsdienās ir svešinieks. Jūs nezināt, kas tas ir, ko tas ir pilnvarots darīt un vai tas ir bojāts. ATP ir protokols, kas to maina,” piebilst Gajs.

Uzņēmums paziņoja, ka protokols ir atvērts un bez autoratlīdzības, un plāno to iesniegt Internet Engineering Task Force, standartu iestādei, kas ir atbildīga par galvenajiem interneta protokoliem. Atsauces ieviešana jau ir izlaista saskaņā ar MIT licenci vietnē GitHub.

Lyrie plašākā platforma apvieno uzbrukuma un aizsardzības drošības rīkus vienā sistēmā. Tās produkti ietver autonomas iespiešanās testēšanas darbplūsmas, GPU paātrinātu red-teaming infrastruktūru, bināro ievainojamību izpētes rīkus un draudu pārklājumu, kas kartēts OWASP aģentu drošības iniciatīvas katalogā.

Lirija pievienojas Anthropic kiberpārbaudes programmai

Jaunuzņēmuma uzņemšana Anthropic kiberverifikācijas programmā arī iekļauj to nelielā organizāciju grupā, kas ir apstiprinātas veikt noteiktas divējāda lietojuma kiberdrošības darbības Kloda AI infrastruktūrā saskaņā ar Anthropic drošības politiku.

“Esot starp pirmajiem uzņēmumiem, kas pieņemti Anthropic kiberpārbaudes programmā, tiek apstiprināts, ko esam izveidojuši. Lyrie nav drošības rīks, kas darbojas līdzās AI. Tas ir drošības slānis, kuram AI darbojas.”

Autonomo AI aģentu pieaugums mudina plašāk pārdomāt kiberdrošību. Vecajā modelī tika pieņemts, ka cilvēki atrodas starp programmatūras sistēmām un augsta riska darbībām. Aģentiskais AI maina šo pieņēmumu.

Drošības firmas tagad sacenšas, lai atbildētu uz sarežģītu jautājumu: kas notiek, kad programmatūra sāk darboties neatkarīgi interneta mērogā?