Ķīniešu AI startsp šokēja globālo tehnoloģiju nozari, kad 2024. gada decembrī tā ieviesa DeepSeek-V3 par nelielu daļu no konkurējošo AI modeļu izmaksām. Atvērtā pirmkoda modelis, kas izstrādāts tikai divu mēnešu laikā par mazāk nekā 6 miljoniem USD, pārspēja Openai un Meta jaunākos AI modeļus vairākos etalonos. Pēc dažām nedēļām, 23. janvārī, uzņēmums iepazīstināja ar DeepSeek-R1-argumentācijas modeli, kas tika uzskatīts par tiešo konkurentu Openai O1.

Kaut arī daži jautājumi par Deepseek apgalvojumu, šī attīstība tomēr izaicina ilgstošo pārliecību, ka sarežģītu AI modeļu veidošanai nepieciešami miljardi dolāru un NVIDIA GPU armija. Tas rada arī jautājumus par masīvo 500 miljardu dolāru lielu Stargate projektu, kuru veicina Openai, Oracle, SoftBank un MGX, kuru mērķis ir izveidot liela mēroga datu centrus visā ASV

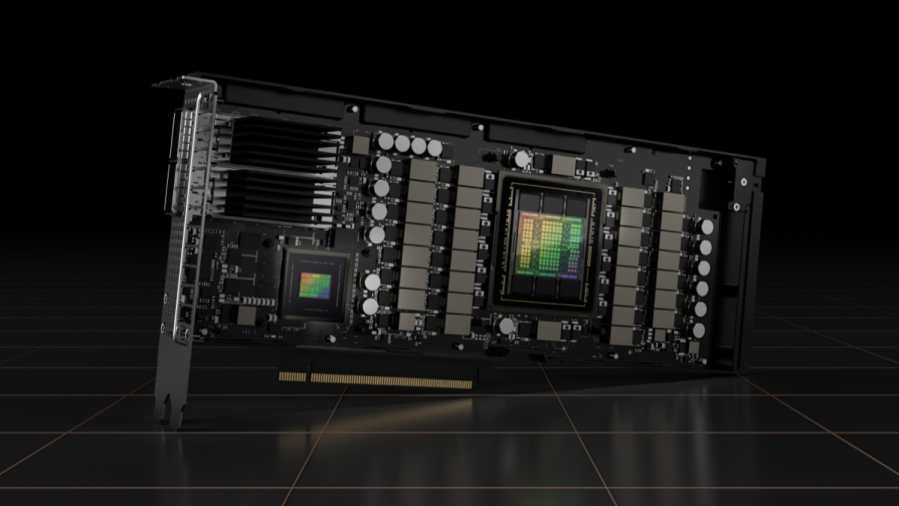

DeepSeek apmācīja savu modeli, izmantojot apmēram 2000 NVIDIA H800 GPU – kas ir mazāk nekā desmitiem tūkstošu, ko parasti izvieto galvenie dalībnieki. Koncentrējoties uz algoritmisko efektivitāti un atvērtā koda sadarbību, uzņēmumam izdevās sasniegt rezultātus, kas salīdzināmi ar Openai Chatgpt par nelielu daļu no izmaksām.

Tirgus reakcija bija tūlītēja. NVIDIA krājums cieta vēsturisku kritumu, slīdot gandrīz par 17% un noslaucot aptuveni 600 miljardus USD tirgus vērtību-lielākie vienas dienas zaudējumi ASV akciju tirgus vēsturē. Trieciens daudziem piespieda pārdomāt nepieciešamību pēc milzīgiem AI infrastruktūras izdevumiem un nozares atkarību no augstākā līmeņa aparatūras.

Daži analītiķi apgalvo, ka DeepSeek panākumi varētu padarīt AI attīstību pieejamāku un ievērojami zemākas izmaksas, pārveidojot konkurenci nozarē.

Vai jūs varat palaist AI un lielas valodas modeļus bez NVIDIA GPU?

Vienkāršs ir jā, NVIDIA GPU nav vienīgā AI modeļu palaišanas iespēja. Kamēr tos plaši izmanto sarežģītu mašīnu apmācības modeļu apmācībai un izvietošanai, pastāv arī citas alternatīvas. Piemēram, AMD GPU piedāvā konkurētspējīgu sniegumu un iegūst vilci AI pētniecībā un attīstībā.

Papildus tradicionālajiem GPU AI modeļi var darboties arī CPU, TPU (Tensora apstrādes vienības), FPGA (lauka programmējami vārtu masīvi) un pat pielāgoti AI paātrinātāji, ko izstrādājuši tādi uzņēmumi kā Apple, Google un Tesla. Aparatūras izvēle ir atkarīga no tādiem faktoriem kā modeļa sarežģītība, ātruma prasības, enerģijas patēriņš un budžeta ierobežojumi.

Liela mēroga dziļas mācīšanās apmācībai NVIDIA GPU ir populāri to optimizētās programmatūras ekosistēmas dēļ, ieskaitot CUDA un CUDNN, kas nemanāmi darbojas ar tādiem ietvariem kā TensorFlow un Pytorch. Tomēr mazākiem uzdevumiem, secinājumu darba slodzēm vai energoefektīvai izvietošanai, tādas alternatīvas kā AMD ROCM, Intel AI paātrinātāji un Google TPU var būt dzīvotspējīgas iespējas.

Ja jūs izstrādājat AI modeļus, ir vērts apsvērt aparatūru, kas vislabāk atbilst jūsu vajadzībām, nevis noklusējumam NVIDIA tikai tāpēc, ka tā ir vispazīstamākā izvēle.

Vai GPU joprojām ir nozīme AI?

DeepSeek izrāviens rada svarīgu jautājumu: vai AI modeļiem tiešām ir nepieciešami Nvidia GPU? Un ja nē, ko tas nozīmē tādiem uzņēmumiem kā NVIDIA, AMD un Broadcom? Vienkārša atbilde ir tā, ka jums nav obligāti nepieciešams NVIDIA GPU vai kādi GPU -, lai palaistu AI modeļus. Piemērs tam ir neironu maģija, AI startup, kas ļauj dziļi mācīties bez specializētas aparatūras

GPU.

Gadiem ilgi GPU ir bijusi izvēle, lai apmācītu dziļas mācīšanās modeļus, taču tie, iespējams, nav nepieciešami katrai AI darba slodzei. Lielāks jautājums ir, vai GPU virzās uz tikpat izplatītu kā mūsdienu CPU – un vai NVIDIA riskē pēc tādu uzņēmumu ceļa kā Cisco, kas savulaik dominēja tīklā, pirms sacensības tika nokļūtu.

Nav vienkāršas atbildes. Kaut arī GPU joprojām ir kritiska augstas veiktspējas AI, efektivitātes uzlabojumi varētu mainīt līdzsvaru, padarot AI pieejamāku bez nepieciešamības pēc milzīgiem aparatūras ieguldījumiem.

CPU pret GPU: Kāda ir atšķirība?

Kas ir CPU?

CPU jeb centrālā apstrādes vienība ir datora operāciju kodols, kas būvēts, lai soli pa solim rīkotos uzdevumus. Tas ir paredzēts elastībai, padarot to lielisku operētājsistēmu palaišanai, ievades un izvades pārvaldībai un vispārējo skaitļošanas darba slodzes apstrādei. Ar dažiem jaudīgiem kodoliem CPU izceļas pēc kārtas apstrādes, bet cīnās, kad vienlaikus jānotiek lielam skaitam aprēķinu. Kā atzīmē LifeWire, CPU ir labi piemēroti uzdevumiem, kuriem nepieciešama precīza izpildīšana, taču tie nav optimizēti masīvai paralēlai apstrādei, kas nepieciešama mūsdienu AI modeļiem.

Kas ir GPU?

GPU jeb grafikas apstrādes vienība sākotnēji tika izstrādāta grafikas veidošanai, bet ir kļuvusi par galveno rīku AI izstrādē. Atšķirībā no CPU, GPU ir iesaiņoti ar simtiem vai tūkstošiem mazāku serdeņu, kas vienlaikus var apstrādāt vairākus aprēķinus. Šī spēja apstrādāt lielu daudzumu datu paralēli padara tos īpaši noderīgus mašīnu apguvē un dziļas mācīšanās lietojumprogrammās. Diskusijas par Reddit AI pētnieku vidū uzsver, kā GPU padara apmācību sarežģītus modeļus ātrāk un efektīvāk, vienlaikus rīkojoties ar milzīgu daudzumu matricas darbību.

Kāpēc AI apmācība paļaujas uz GPU

Paralēla apstrāde

AI modeļu apmācība – it īpaši dziļi neironu tīkli – iedziļina miljoniem vai pat miljardiem aprēķinu. GPU ir veidoti, lai efektīvi apstrādātu šīs darba slodzes, izplatot tās daudzos kodolos, lai paātrinātu procesu. No otras puses, CPU būtu jātiek galā ar katru soli pa vienam, izraisot ilgāku apmācības laiku. Izmantojot GPU, apmācība notiek ātrāk, ļaujot pētniekiem un izstrādātājiem ātrāk atkārtoties modeļiem.

Optimizēts AI ietvars

Daudzas no šodienas labākajām mašīnmācīšanās bibliotēkām, ieskaitot Tensorflow un Pytorch, ir veidotas, lai izmantotu GPU paātrinājuma priekšrocības. Šie ietvari ne tikai gūst labumu no pašas aparatūras-tiem ir arī iebūvētie rīki, kas racionalizē AI modeļa izstrādi. Tas ir liels iemesls, kāpēc pētnieki un uzņēmumi mēdz ieguldīt lielus ieguldījumus GPU balstītos iestatījumos.

Kad GPU varētu nebūt nepieciešams

Secinājumi pret apmācību

Kaut arī GPU ir kritiska loma AI modeļu apmācībā, tie ne vienmēr ir nepieciešami šo modeļu vadīšanai reālās pasaules lietojumprogrammās. Kad modelis ir apmācīts, tas bieži var padarīt prognozes par CPU bez nozīmīgiem palēnināšanos, it īpaši scenārijos, kur ātrums nav prioritāte. Viegliem uzdevumiem CPU var būt rentablāka un energoefektīvāka izvēle.

Agrīnās stadijas attīstība

Ja strādājat pie neliela mēroga projekta vai vienkārši eksperimentējat, lieljaudas GPU varētu nebūt nepieciešams. Daudzas mākoņu platformas piedāvā piekļuvi GPU, ļaujot izstrādātājiem sākt CPU un uzlabot viņu vajadzības. Dažos gadījumos mazi modeļi var darboties ar CPU bez lielām veiktspējas problēmām, lai gan izpildes laiks var būt lēnāks.

Alternatīva aparatūra

Papildus CPU un GPU pastāv citas iespējas, piemēram, tensora apstrādes vienības (TPU) un specializētas secinājumu mikroshēmas. TPU, ko izstrādājusi Google, ir optimizētas īpašām AI darba slodzēm un dažreiz var pārspēt GPU. Tomēr tiem ir unikālas iestatīšanas prasības, tāpēc vairums izstrādātāju elastīguma dēļ turpina paļauties uz GPU.

Izmaksas un energoefektivitāte

GPU ir jaudīgi, taču tie ir arī dārgi un patērē daudz enerģijas. Uzņēmumiem ar ierobežotiem budžetiem vai ilgtspējības bažām var nākties izsvērt GPU lietošanas priekšrocības, salīdzinot ar pieturvietu ar augstas veiktspējas CPU vai hibrīda pieeju. Ja jūsu lietojumprogrammai nav nepieciešama liela mēroga paralēla apstrāde, CPU varētu būt praktiskāka izvēle.

Pareizā aparatūra darbam

Tas, vai GPU ir nepieciešams, ir atkarīgs no jūsu AI darba slodzes rakstura:

- Lielu AI modeļu apmācība – Ja jūs strādājat ar masīvām datu kopām un sarežģītiem neironu tīkliem, GPU ir gandrīz būtiska. Ātruma uzlabojumi salīdzinājumā ar CPU var būt nozīmīgi.

- Precīzi – Mazākiem modeļiem un secinājumu uzdevumiem CPU bieži var apstrādāt darba slodzi bez lielām palēnināšanām.

- Budžeta un veiktspējas līdzsvarošana – Ja izmaksu vai enerģijas patēriņš rada bažas, labākā pieeja varētu būt CPU un GPU sajaukums.

Pareizā izvēle ir atkarīga no jūsu īpašajām projekta vajadzībām, veiktspējas mērķiem un pieejamajiem resursiem. AI aparatūras lēmumi turpinās attīstīties, bet izpratne par to, ko CPU un GPU sniedz galdā, palīdzēs jums pieņemt labāko lēmumu jūsu darbam. Neatkarīgi no tā, vai jūs sākat ar CPU vai dodaties uz visiem GPU, aparatūras saskaņošana ar sava projekta prasībām ir atslēga, lai iegūtu labākos rezultātus.

Zemāk ir video par to, kā jūs varat palaist lielas valodas modeļus savā vietējā mašīnā.

https://www.youtube.com/watch?v=mugsv_iht-g