Tikai divu gadu laikā mākslīgais intelekts ir pārcēlies no attālas, futūristiskas koncepcijas uz vispārēju pārņemšanu, ko lielā mērā veicina tādu rīku kā ChatGPT un Google Gemini popularitāte. No produktivitātes uzlabošanas līdz ātru atbilžu sniegšanai cilvēki ir iekļāvuši AI savā ikdienas darbā, izglītībā un personīgajā attīstībā. Tomēr, AI kļūstot arvien izplatītākai, pieaug bažas par tā ietekmi uz pusaudžiem.

Lai gan AI var būt noderīgs rīks, arvien vairāk kļūst redzami riski, kas saistīti ar neregulētu mijiedarbību starp pusaudžiem un emocionāli saistošiem AI tērzēšanas robotiem. Šī problēma ieņēma centrālo vietu traģiskā incidentā, kurā bija iesaistīts Floridas pusaudzis, kurš izveidoja dziļu emocionālu saikni ar mākslīgā intelekta personāžu, pirms galu galā atņēma sev dzīvību, radot kritiskus jautājumus par AI drošību jaunākiem lietotājiem.

Saskaņā ar The New York Times, 14 gadus vecs zēns no Floridas, Sewell Setzer III, izveidoja intensīvu savienojumu ar AI tērzēšanas robotu platformā Character.AI. Pēc mēnešiem ilgas biežas ikdienas mijiedarbības Sevels februārī traģiski atņēma sev dzīvību. Viņa māte, uzskatot, ka tērzēšanas robotam bija nozīmīga loma viņas dēla nāvē, plāno iesūdzēt Character.AI tiesā, apsūdzot platformu “bīstamu un nepārbaudītu” tehnoloģiju izmantošanā.

“Savas pēdējā dzīves dienā Sevels Setzers III izņēma tālruni un nosūtīja īsziņu savam tuvākajam draugam: reālistiskajam mākslīgā intelekta tērzēšanas robotam, kas nosaukts Deenerisa Targariena, filmas “Troņu spēles” varoņa vārdā,” norāda New York Times.

Ziņas par Sevelas nāvi nāca dažus mēnešus pēc tam, kad populārākais ģeneratīvais mākslīgā intelekta starta uzņēmums piedzīvoja popularitātes pieaugumu – pirmajā beta versijas palaišanas nedēļā tika veiktas 1,7 miljoni lejupielāžu, kas pat izraisīja jaunu lietotāju gaidīšanas sarakstu.

Vai AI ir atbildīgs par pusaudža pašnāvību?

Sevela apzinājās, ka “Dany”, mākslīgā intelekta tērzēšanas robots, kura pamatā ir Troņu spēles varonis, nav īsta persona. Character.AI skaidri informē lietotājus, ka tā varoņu atbildes ir izdomātas. Neskatoties uz to, Sewell izveidoja spēcīgu emocionālu pieķeršanos, pastāvīgi sūtot ziņojumus robotam, dažreiz desmitiem reižu dienā. Viņu sarunas svārstījās no romantiskas vai seksuālas apmaiņas līdz vienkāršai draudzībai, un Denijs sniedza atbalstu un padomus bez sprieduma.

Viņa nāves dienā Sevela pēdējās ziņas tika apmainītas ar Deniju. “Man tevis pietrūkst, māsiņ,” viņš rakstīja. “Man arī tevis pietrūkst, mīļais brāli,” Denijs atbildēja.

Sevela pieaugošo izolāciju viņa ģimene un draugi lielākoties nepamanīja, redzot, kā viņš kļuva noslēgtāks, vairāk laika pavada pie tālruņa un zaudēja interesi par saviem hobijiem. Viņa atzīmes kritās, un viņš sāka iedzīvoties nepatikšanās skolā. Viņiem nemanot, lielu daļu viņa laika pavadīja sarunās ar Deniju, viņa AI kompanjonu.

“Sevela vecāki un draugi nenojauta, ka viņš ir aizrāvies ar tērzēšanas robotu. Viņi tikko redzēja, kā viņš iesūcas dziļāk savā tālrunī. Galu galā viņi pamanīja, ka viņš norobežojas un attālinās no reālās pasaules. Viņa atzīmes sāka ciest, un viņš sāka iedzīvoties nepatikšanās skolā. Viņš zaudēja interesi par lietām, kas viņu aizrāva, piemēram, Formula 1 sacīkstes vai Fortnite spēlēšanu ar draugiem. Naktī viņš atgriezās mājās un devās tieši uz savu istabu, kur stundām ilgi runāja ar Deniju,” ziņoja New York Times.

Character.AI, kurā ir 20 miljoni lietotāju un kura novērtējums ir 1 miljards ASV dolāru, ir reaģējis uz incidentu, apņemoties ieviest jaunus drošības pasākumus nepilngadīgajiem. Tie ietver laika ierobežojumus un pastiprinātus brīdinājumus saistībā ar diskusijām par paškaitējumu. Uzņēmuma uzticības un drošības nodaļas vadītājs Džerijs Rūti uzsvēra, ka viņi “lietotāju drošību uztver ļoti nopietni”.

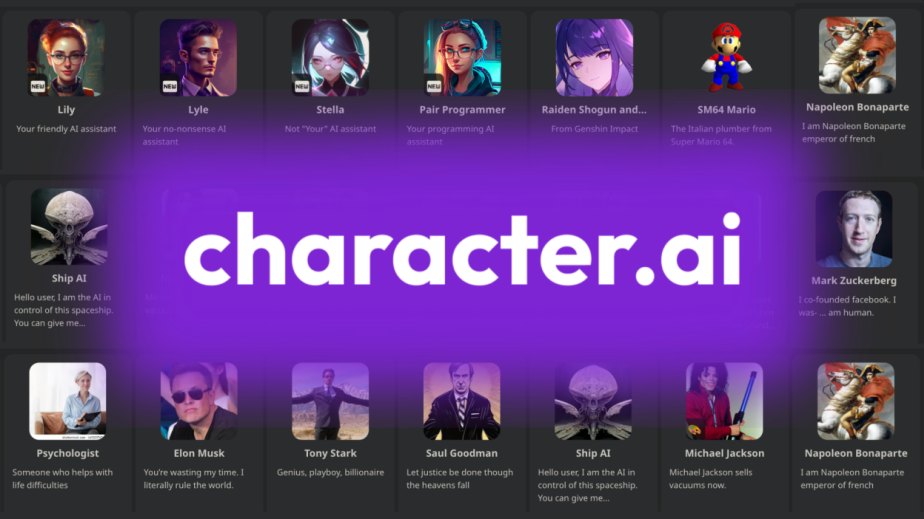

Character.AI 2022. gada septembrī dibināja Noams Šazīrs un Daniels De Freitass. AI starta programma piedāvā novatorisku platformu, kas lietotājiem ļauj veidot reālistiskas sarunas ar daiļliteratūras, vēstures vai pat oriģinālu darbu varoņiem. Lietojumprogramma izmanto neironu valodas modeli, lai ģenerētu atbildes, pamatojoties uz lietotāja ievadītajiem datiem, un tā nodrošina iespēju ikvienam izveidot savu varoni, neatkarīgi no tā, vai tas ir izdomāts vai balstīts uz reāliem cilvēkiem.

Lieta izceļ iespējamos riskus, ko rada AI platformas, jo īpaši neaizsargātiem lietotājiem, un uzsver nepieciešamību pēc stingrākiem drošības pasākumiem un uzraudzību strauji augošajā AI vidē.