Microsoft ir paziņojusi par jaunu Azure AI platformas atjauninājumu. Tas ietver halucināciju un ļaunprātīgu tūlītēju uzbrukumu noteikšanas un mazināšanas sistēmas. Azure AI klientiem tagad ir pieejami jauni LLM rīki, kas ievērojami uzlabo aizsardzības līmeni pret nevēlamām vai neparedzētām atbildēm viņu AI lietojumprogrammās.

Microsoft stiprina Azure AI aizsardzību, izmantojot halucinācijas un ļaunprātīgu uzbrukumu noteikšanu

Sāra Bērda, Microsoft atbildīgā AI produktu nodaļas vadītāja, skaidro, ka šie drošības līdzekļi aizsargās “vidējo” Azure lietotāju, kurš, iespējams, nespecializējas AI ievainojamību identificēšanā vai labošanā. TheVerge to plaši aplūkoja un izvairījās no tā, kā šie jaunie rīki var identificēt iespējamās ievainojamības, uzraudzīt halucinācijas un bloķēt ļaunprātīgas uzvednes reāllaikā, organizācijas iegūs vērtīgu ieskatu savu AI modeļu veiktspējā un drošībā.

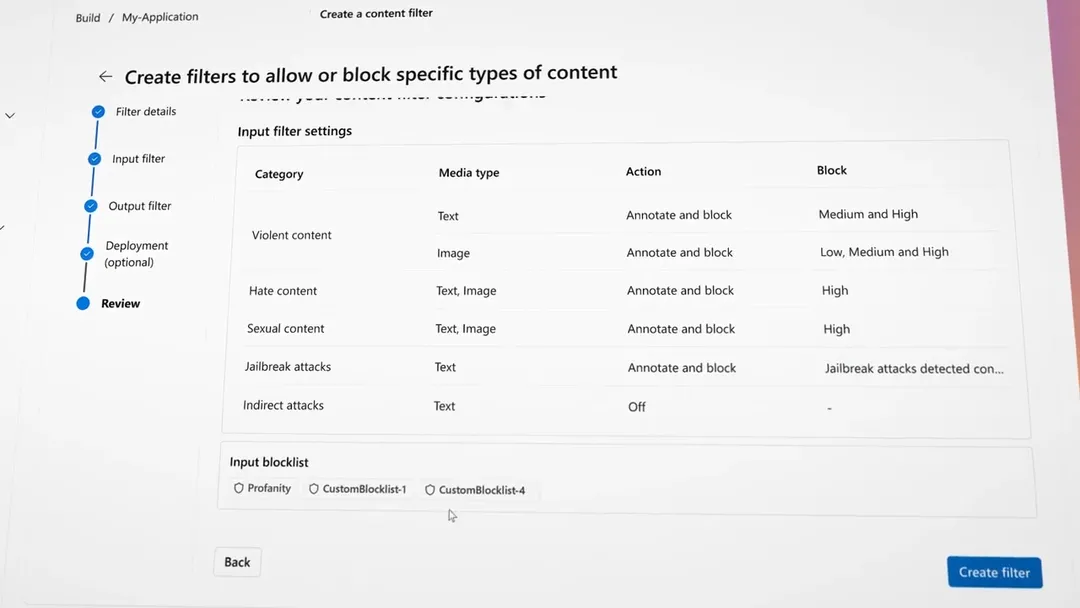

Šīs funkcijas ietver uzvedņu vairogus, lai novērstu tūlītējas injekcijas/ļaunprātīgus uzvednes, pamatotības noteikšanu halucināciju identificēšanai un drošības novērtējumus, kas novērtē modeļa ievainojamību. Lai gan Azure AI šie atribūti jau ir priekšskatījumā, turpmākajos laidienos ir paredzētas citas funkcijas, piemēram, modeļu virzīšana uz drošām izvadēm vai potenciāli problemātisku lietotāju izsekošana.

Viena lieta, kas atšķir Microsoft pieeju, ir uzsvars uz pielāgotu vadību, kas ļauj Azure lietotājiem AI modeļos pārslēgt filtrus naida runai vai vardarbībai. Tas palīdz novērst bažas par aizspriedumiem vai nepiemērotu saturu, ļaujot lietotājiem pielāgot drošības iestatījumus atbilstoši savām īpašajām prasībām.

Uzraudzības sistēma pārbauda, vai uzvednēs un atbildēs nav aizliegtu vārdu vai slēptu uzvedņu, pirms tie tiek nodoti modelim apstrādei. Tas novērš jebkādas iespējas likt AI radīt rezultātus, kas neatbilst vēlamajiem drošības un ētikas standartiem, un rezultātā rodas strīdīgi vai kaitīgi materiāli.

Tagad Azure AI drošības un aizsardzības ziņā konkurē ar GPT-4 un Llama 2

Lai gan šīs drošības funkcijas ir viegli pieejamas populāros modeļos, piemēram, GPT-4 un Llama 2, tiem, kas izmanto mazākas vai mazāk zināmas atvērtā pirmkoda AI sistēmas, var būt nepieciešams manuāli iekļaut tās savos modeļos. Tomēr Microsoft apņemšanās uzlabot mākslīgā intelekta drošību un drošību apliecina tās apņemšanos nodrošināt stabilus un uzticamus AI risinājumus vietnē Azure.

Microsoft centieni uzlabot drošību liecina par pieaugošu interesi par AI tehnoloģiju atbildīgu izmantošanu. Tāpēc Microsoft mērķis ir izveidot drošāku un drošāku vidi, kurā klienti var atklāt un novērst riskus, pirms tie tiek īstenoti, izmantojot AI ekosistēmu Azure.