Tiktokas mātesuzņēmums Bitedance ir ieviesis Omnihuman-1, AI modeli, kas spēj pārveidot vienu attēlu un audio klipu satriecoši dzīvesveidīgā cilvēka videoklipos. Reālisma līmenis ir tik precīzs, ka tā izlaide no faktiskajiem materiāliem kļūst arvien grūtāka.

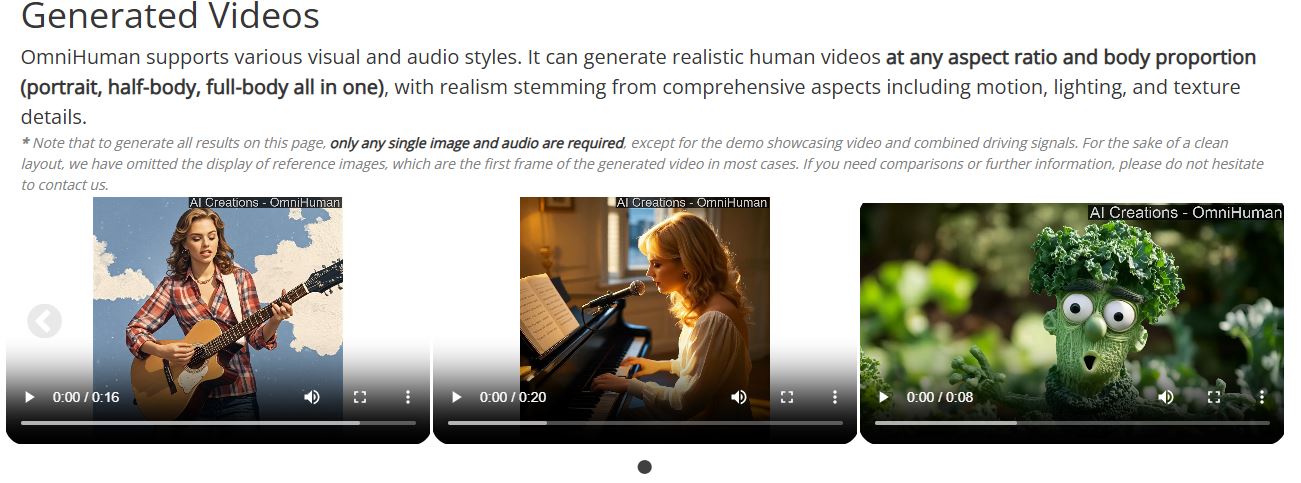

Omnihuman-1 var radīt šķidruma, dabisku kustību visās malu attiecībās vai ķermeņa proporcijā, nodrošinot nemanāmu pielāgošanos dažādiem formātiem. Ar tikai vienu attēlu un audio celiņu tas rada izcili autentiskus cilvēku videoklipus, ar neticamu precizitāti uztverot sejas izteiksmes, žestus un runas sinhronizāciju. Kaut arī tehnoloģija ir pievērsusi uzmanību savām iespējām, tā pašlaik nav pieejama publiskai lietošanai vai lejupielādei.

Saskaņā ar informāciju, kas kopīgota GitHub projekta lapā, Omnihuman ir uzlabots AI ietvars, kas paredzēts, lai izveidotu cilvēku videoklipus no viena attēla, izmantojot kustības norādes, piemēram, audio, video vai abu kombināciju. Atšķirībā no iepriekšējiem modeļiem, kas cīnījās ar datu ierobežojumiem, Omnihuman izmanto multimodālu apmācības stratēģiju, lai uzlabotu precizitāti un reālismu, pat ar minimālu ievadi. Sistēma darbojas ar jebkuras malu attiecības-pilnveidošanas, puspaudzes vai pilna ķermeņa-attēliem, kas nodrošina ļoti dzīvojošus rezultātus dažādos formātos.

“Mēs piedāvājam cilvēku ģenerēšanas ietvaru ar nosaukumu Omnihuman, kas var ģenerēt cilvēku videoklipus, kuru pamatā ir viens cilvēka attēla un kustības signāli (piemēram, tikai audio, tikai video, vai tikai audio un video kombināciju), kas tikai ar audio un video) var ģenerēt cilvēku videoklipus (piemēram, tikai video). , ”Bydedance pētnieki sacīja amatā par Github.

Bitedance apgalvoja, ka Omnihuman ievērojami pārspēj esošās metodes, īpaši radot reālistisku cilvēka kustību tikai no audio.

Kā darbojas Omnihuman-1

Omnihuman-1 ir veidots uz 19 000 stundas video apmācības datiļaujot tam analizēt fotoattēlu, apstrādāt kustības norādes un animēt tēmu ar dabiskām izteiksmēm, runas sinhronizāciju un ķermeņa kustībām. AI to sadala divos soļos:

- Kustības apstrāde – Tas saspiež kustības datus no avotiem, piemēram, audio un teksta uzvednes.

- Izsmalcinātība -Tas precizē animāciju, salīdzinot tā izvadi ar reāliem videoklipiem, lai nodrošinātu precizitāti.

Viena izcila funkcija ir tā spēja pielāgot malu attiecības un ķermeņa proporcijas, kas nozīmē, ka tā var ģenerēt videoklipus, kas atbilst dažādiem formātiem, vienlaikus saglabājot reālistisku kustību. Tas pat darbojas ar cilvēkiem, kas nav cilvēki, ieskaitot multfilmu rakstzīmes un sarežģītas pozas.

Demonstrācijas, kas aizrauj robežu starp AI un realitāti

Bytedance nav publiskojusi Omnihuman-1, bet agrīnās demonstrācijas rodas viļņus tiešsaistē. Vienā klipā ir redzams 23 sekunžu videoklips, kurā redzams Alberts Einšteins ar runu ar kustībām un izteicieniem, kas izskatās ārkārtīgi reāli.

Bytedance, uzņēmums, kas atrodas aiz Tiktokas, tikko paziņoja par revolucionāra video modeli Omnihuman-1.

Tikai ar vienu attēlu un audio celiņu tas var ģenerēt hiperreālistiskus cilvēku videoklipus, nemanāmi pielāgojoties jebkurai malu attiecībai vai ķermeņa formai.

Piemērs: pic.twitter.com/smicuc2u6a

– Braiens Roemmele (@Brianroemmele) 2025. gada 5. februāris

Tajā pašā laikā šī tehnoloģija izraisa nopietnas bažas. Tā kā vairāk ASV valstu pieņem likumus pret AI radītiem uzdošanās par reālo saturu no sintētiskajiem plašsaziņas līdzekļiem kļūst par arvien steidzamāku izaicinājumu. Šādi AI rīki varētu no jauna definēt satura izveidi, bet tie arī atver durvis ētiskām un normatīvām debatēm, kurām joprojām trūkst skaidru risinājumu.

Kas tālāk?

Omnihuman-1 ir izveidojis jaunu etalonu AI ģenerētam video. Iespēja radīt dzīvības animācijas no viena attēla vairs nav futūristiska koncepcija – tā ir šeit. Lielāks jautājums ir, vai pasaule tam ir gatava.