Februārī OpenAI guva lielu slavu, atklājot Sora — iespaidīgu AI rīku, kas var pārveidot teksta uzvednes saistošos videoklipos. Izmantojot Sora, lietotāji var iedvest dzīvību savās idejās, vērojot, kā mākslīgais intelekts no īsiem teksta norādēm veido dinamiskus 60 sekunžu video. Bet kāds cits pilsētas spēlētājs ir guvis viļņus internetā: VideoPoet, video ģenerēšanas rīks no Google, kas parādījās trīs mēnešus iepriekš.

VideoPoet ir Google Research 31 pētnieka komandas ideja, un tas ir daudzveidīgs multivides radīšanas pasaulē. Kamēr Sora koncentrējas uz teksta pārvēršanu vizuālos stāstos, VideoPoet izmanto citu pieeju. Tas ir izcils, veidojot reālistiskus videoklipus, izmantojot tekstu, attēlus vai pat esošus videomateriālus, pateicoties progresīvām metodēm, piemēram, autorregresīvai valodas modelēšanai un marķieriem, piemēram, MAGVIT V2 un SoundStream. Šī daudzpusība paver iespēju pasauli digitālajai mākslai, filmu veidošanai un interaktīviem medijiem.

VideoPoet izceļas ar tās unikālo arhitektūru. Lai gan daudzi video ģenerēšanas modeļi balstās uz difūziju balstītām metodēm, kuras tiek uzskatītas par labākajām šajā jomā, Google Research izvēlējās citu ceļu. Tā vietā, lai izmantotu populāro stabilās difūzijas modeli, Google pētnieki izvēlējās lielu valodas modeli (LLM), kura pamatā ir transformatora arhitektūra. Šāda veida mākslīgā intelekta modelis, ko parasti izmanto teksta un koda ģenerēšanai, ir pārveidots, lai ģenerētu videoklipus — tas ir drosmīgs solis, kas izceļ VideoPoet no pūļa.

“Lielākajā daļā esošo modeļu tiek izmantotas uz difūziju balstītas metodes, kuras bieži tiek uzskatītas par pašreizējiem labākajiem video ģenerēšanas rādītājiem. Šie video modeļi parasti sākas ar iepriekš sagatavotu attēla modeli, piemēram, Stable Diffusion, kas rada augstas precizitātes attēlus atsevišķiem kadriem, un pēc tam precīzi noregulē modeli, lai uzlabotu video kadru laika konsekvenci, ”sacīja Google pētniecības komanda savā iepriekšējā ziņojumā. apskata pētniecisko darbu.

Kas ir VideoPoet un kā tas darbojas?

Savā pamatā VideoPoet izmanto autoregresīvu valodas modeli, lai mācītos no dažādām modalitātēm, piemēram, video, attēla, audio un teksta. Tas ir iespējams, izmantojot vairākus marķierus — MAGVIT V2 video un attēlam un SoundStream audio.

Kad modelis ģenerē marķierus, pamatojoties uz doto kontekstu, šie marķieri vēlāk tiek pārveidoti atpakaļ redzamā attēlojumā, izmantojot attiecīgā marķiera dekodētāju. Tas nodrošina netraucētu tulkošanu starp dažādiem plašsaziņas līdzekļu veidiem, nodrošinot vienotu un visaptverošu izpratni par visiem veidiem. Tālāk ir norādīti VideoPoet komponenti:

- Iepriekš apmācīti MAGVIT V2 un SoundStream marķieri, kas pārvērš attēlus, video un audio klipus modelim saprotamā kodu secībā.

- Autoregresīvs valodas modelis, kas mācās no dažādām modalitātēm — video, attēla, audio un teksta —, lai paredzētu nākamo marķieri secībā.

- Virkne ģeneratīvu mācību mērķu, tostarp teksta pārvēršana video, teksta pārvēršana attēlā, attēls pārveide video un citi, kas ļauj VideoPoet izveidot daudzveidīgus un augstas kvalitātes videoklipus.

Revolucionāras funkcijas un iespējas

Tāpat kā Sora un Stable Diffusion, arī VideoPoet ir dažas revolucionāras funkcijas, kas sniedz jaunu skatījumu uz video veidošanu.

Augstas kustības mainīga garuma video: Atšķirībā no tradicionālajiem modeļiem, VideoPoet bez piepūles veido mainīga garuma video augstas kustības, nospiežot video ģenerēšanas iespējas.

Cross-Modality mācīšanās: Viena no VideoPoet stiprajām pusēm ir tā spēja mācīties dažādās modalitātēs. Pārvarot plaisu starp tekstu, attēliem, video un audio, VideoPoet piedāvā holistisku izpratni, kas bagātina radošo procesu.

Interaktīvās rediģēšanas iespējas: VideoPoet ne tikai ģenerē videoklipus, bet arī sniedz lietotājiem interaktīvas rediģēšanas funkcijas. No ievades videoklipu paplašināšanas līdz kustību kontrolei un stilizētu efektu pielietošanai, pamatojoties uz teksta uzvednēm, tas nodod radošo vadību lietotāja rokās.

Google VideoPoet ir kas vairāk nekā tikai video ģenerēšanas rīks — tas ir spēles mainītājs AI pasaulē. Nemanāmi integrējot vairākas iespējas vienā lielā valodas modelī (LLM), tas no jauna definē video ģenerēšanas ainavu. Tā daudzpusība teksta, attēlu un audio apstrādē padara to neaizstājamu gan satura veidotājiem, gan AI entuziastiem, nosakot jaunus standartus radošumam un inovācijām.

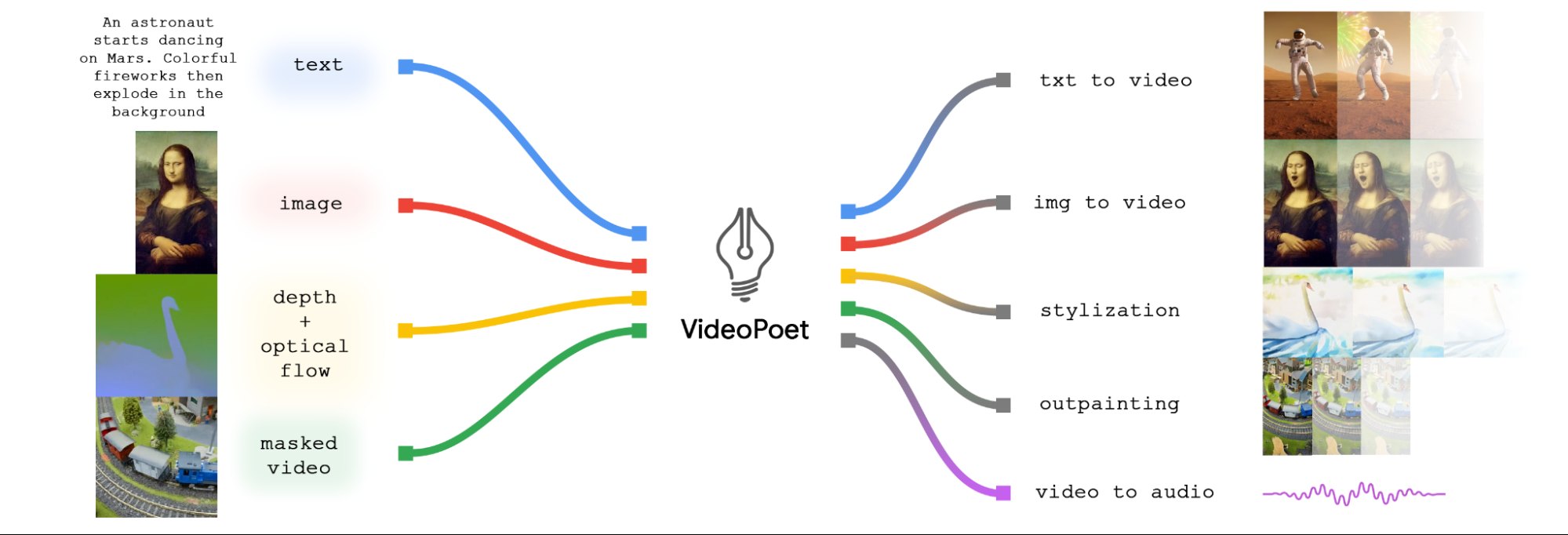

Tālāk ir sniegts VideoPoet iespēju sadalījums, izmantojot tālāk redzamo diagrammu.

Pirmkārt, ievades attēlus var atdzīvināt ar animāciju, radot dinamisku kustību videoklipā. Turklāt lietotājiem ir iespēja rediģēt videoklipus, apgriežot vai maskējot noteiktus apgabalus, nodrošinot nemanāmus krāsošanas vai pārkrāsošanas efektus.

Runājot par stilizāciju, modelis darbojas kā burvīgs, analizējot video, kas tver dziļumu un optisko plūsmu — būtībā kustību ainā. Izmantojot šo informāciju, tas izmanto stilistiskus elementus, vadoties pēc teksta uzvednēm, uzlabojot videoklipa vispārējo vizuālo pievilcību.

Bet pietiek tehniskā žargona — parunāsim par rezultātiem. Lai parādītu VideoPoet spējas, Google pētniecības komanda izveidoja īsfilmu, kuras pamatā bija stāstu mākslinieciskā intelekta Bard norādījumi. Rezultāts? Burvīgs stāsts par ceļojošo jenotu, kas atdzīvināts, izmantojot valdzinošu videoklipu sēriju. Tas ir apliecinājums AI spēkam stāstu izstāstīšanā un ieskats multivides radīšanas nākotnē.

Pasaulē, kurā saturs ir karalis, tādi rīki kā Sora un VideoPoet maina spēli, dodot satura veidotājiem iespēju īstenot savas idejas tā, kā tas vēl nekad nav bijis iespējams. Ar savām uzlabotajām iespējām un lietotājam draudzīgajām saskarnēm šie AI vadītie rīki ir gatavi mainīt to, kā mēs stāstām un izpaužam sevi, izmantojot video.