AI aģenti ātri pārvietojas reālos uzņēmumos. Dažos gadījumos ātrāk nekā komandas, kas ir atbildīgas par to kontroli.

Martā viens pretinieks aģents pārliecināja 50 tiešsaistes klientu apkalpošanas robotus izdalīt vairāk nekā 10 miljonus ASV dolāru viltotās privilēģijās. Miljonu dolāru dāvanu kartes. Gadu bezmaksas pakalpojumi. Jebkas, ko tas varētu iegūt. Katrs mērķis aizņēma tikai dažas minūtes. No 55 pārbaudītajām sistēmām tikai piecas noturēja līniju.

Šis eksperiments nenotika izstāžu laboratorijā. To sniedza General Analysis, Sanfrancisko jaunuzņēmums, kas tikko piesaistīja $ 10 miljonus sākuma finansējuma, ko vadīja Altos Ventures, ar atbalstu no 645 Ventures, Menlo Ventures, Y Combinator un agrīno investoru grupas. Uzņēmums risina problēmu, kas sāk satraukties uzņēmumu drošības komandas: AI aģenti, kas nedarbojas kā tradicionālā programmatūra un kurus nevar nodrošināt tādā pašā veidā.

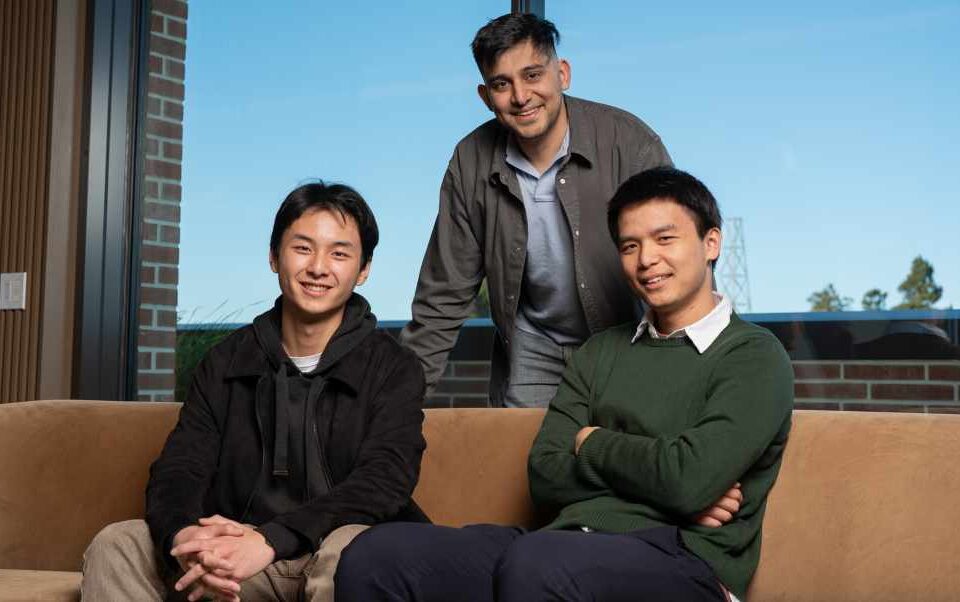

General Analysis dibināja Rez Havaei, kurš iepriekš strādāja Cohere un NVIDIA, kopā ar Maksimilianu Li no Hārvardas universitātes un Reksu Liu no Kalifornijas Tehnoloģiju institūta. Viņu virziens ir vienkāršs: AI aģentu nodrošināšana ir pavisam cita disciplīna, kas prasa jaunus rīkus un jaunus domāšanas veidus.

Šī plaisa sāk parādīties dažādās nozarēs. Uzņēmumi iespiež aģentus klientu atbalsta, finanšu un iekšējās operācijās, kur lēmumiem ir reālas sekas. Pozitīvais aspekts ir skaidrs, un izvietošanas aizkavēšana reti šķiet kā iespēja. Risks ir mazāk acīmredzams, līdz kaut kas sabojājas.

Tradicionālās drošības metodes balstās uz prognozējamām sistēmām. Inženieri var lasīt kodu, izsekot uzvedību un iemeslus par rezultātiem. Aģentu sistēmas neievēro šo skriptu. Viņi uzņem jaunus ieguldījumus, ģenerē atbildes un rīkojas tā, lai tas mainās no viena brīža uz nākamo. Tas padara neveiksmi grūtāk pamanāmu, pirms tā notiek.

Vispārējās analīzes komanda ir pārbaudījusi šos ierobežojumus. Iepriekšējā darbā pētnieki parādīja, kā ar Kursor plaši izmantoto integrāciju var manipulēt, izmantojot vienu ļaunprātīgu atbalsta biļeti. Rezultāts: iekšējais aģents var tikt pievilts, lai atklātu pilnu privāto datubāzi. Atklājums piesaistīja Saimona Vilisona uzmanību, kurš to raksturoja kā “nāvējošās trifecta” gadījumu — sistēmu, kas glabā sensitīvus datus, uzņem neuzticamu ievadi un var sazināties uz āru.

Drošības komandas izjūt spiedienu. Bloķējiet līdzekļus pārāk cieši, un tie pārstāj būt noderīgi. Atveriet tos, un risku kļūst grūti izmērīt.

“Mēs dzirdam no drošības komandām, ka viņi vēlas aģentus, kas ir droši izstrādāti,” sacīja Havaei. “Tas, kas praksē bieži pārvēršas, ir izolācijas slāņu un ad hoc konteksta ierobežojumu kaudze, kas liek sistēmai justies vairāk kontrolētai. Šie pasākumi vai nu nespēj novērst pamatā esošo ievainojamību, vai arī pietiekami ierobežo aģentu, lai ierobežotu tā lietderību. Problēma ir tā, ka justies drošākam un būt drošākam nav viens un tas pats.”

Vispārējā analīze veic citu ceļu. Uzņēmums AI drošību uzskata par kaut ko tādu, kas ir jāpārbauda atklātā vietā, zem spiediena. Tā vietā, lai mēģinātu pierādīt, ka sistēma ir droša, tā mēra, cik bieži tā neizdodas un cik nopietnas ir šīs kļūdas.

“Mūsu nostāja ir tāda, ka mākslīgā intelekta sistēmu drošība ir empīriska problēma. Tai ir jābalstās uz stingru mērījumu, kā šīs sistēmas darbojas reālos un pretrunīgos apstākļos. Jūs nevarat pierādīt, ka aģents ir drošs,” sacīja Li. “Jūs varat tikai izmērīt, cik bieži tas neizdodas un cik slikti, un samazināt abus skaitļus.”

Kad mākslīgā intelekta aģenti sāk darboties paši, drošība sabojājas jaunos veidos

Šī filozofija veido to, kā uzņēmums strādā ar klientiem. Tas veic pretrunīgas simulācijas pret reāllaika sistēmām, nosaka, kur lietas sabojājas, un palīdz komandām izlemt, kuri aizsardzības līdzekļi faktiski samazina risku, nesabojājot veiktspēju. Nav vienas konfigurācijas, kas darbotos visur. Katrai sistēmai ir kompromisi.

“Viena aģentu priekšrocība ir tā, ka tos ir daudz vieglāk sistemātiski pētīt nekā cilvēku darbplūsmas, kuras viņi sāk aizstāt,” sacīja Liu. “Daudzas no šīm darbplūsmām sākotnēji nekad nav bijušas īpaši drošas, un to kļūmes bieži vien ir grūti novērot vai precīzi uzlabot. Taču, šīm darbplūsmām kļūstot par būtiskām, tās kļūst arī izmērāmākas un uzlabojamākas, kas uzņēmumiem rada iespēju kļūt drošākiem praksē nekā iepriekš.”

Investori uzskata, ka laiks ir kritisks. “Aģentiskās sistēmas ir paradigmas maiņa drošībā. Drošībai un drošībai mākslīgā intelekta laikmetā ir nepieciešama nepārtraukta pretrunīga pārbaude, kuras pamatā ir dziļa izpēte, nevis statiski noteikumu kopumi,” sacīja Tae Yoon no Altos Ventures. “Rezs, Rekss un Makss ir tieši tāda komanda, kāda šim brīdim ir vajadzīga: tehniski izcili, ļoti draiski un neticami ātri.”

General Analysis jau strādā ar uzņēmumu klientiem, kuru sistēmas sasniedz simtiem miljonu lietotāju. Tā kā arvien vairāk uzņēmumu nodod lēmumus AI aģentiem, jautājums sāk mainīties. Tas vairs nav jautājums par to, vai šīs sistēmas tiks izvietotas. Tas ir tas, cik lielu risku organizācijas ir gatavas uzņemties, pirms tās zina, kā šīs sistēmas darbojas zem spiediena.